AI音声アシスタントの注目株?! 「EMVI」を使ってみたエーアイ音声アシスタントの注目株?!エンヴィを使ってみた

視覚に障害のある人をサポートするアプリとして注目されているBe My Eyes。

最近はChatGPT(チャットジーピーティー)などで話題のOpenAI(オープンエーアイ)の言語モデルが搭載されたBe My AIも登場してさらに話題となっていますが、個人的に「もしかしてこれ、かなりすごいのでは?」と注目しているスマートフォン用アプリを見つけたので紹介します。

CSUN(シーサン)で発見

さかのぼること2024年の3月。アメリカで行われたアクセシビリティ関連のイベントCSUN(シーサン)でみつけました。海外製の、画像認識したものを音声で伝えてくれる「EMVI(エンヴィ)」というアプリです。

ホームページには「世界初の AI(エーアイ) ビジュアルアシスタントは、視覚支援だけでなく、日常生活を形作る環境との深いつながりを提供します。」と記載されています。

現在リリース前ですが、特別にテスト版を使わせてもらいました。

対話形式のシンプルな操作

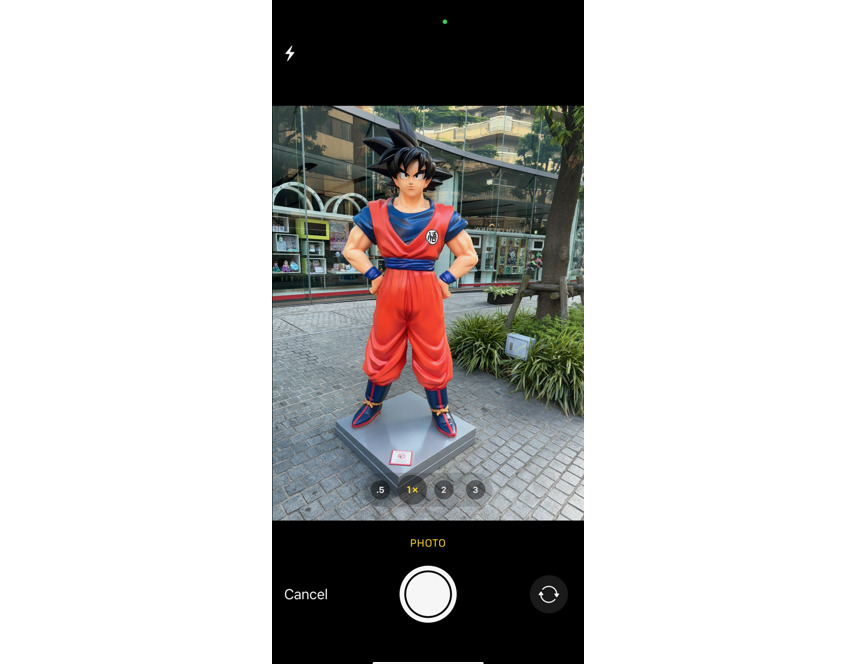

操作はシンプル。アプリを起動すると表示される画面中央の大きな丸いボタンを押して発話し、会話しながらすすめます。これが基本動作です。

たとえば目の前にあるものが何か知りたいとき。ボタンを押して「写真を撮りたい」と伝えるとカメラモードになります。

設定しなくともほぼ音声だけでカメラが起動するのはかなり便利ではないでしょうか。ただし、これらのやりとりはすべて英語でおこなわれるので多少の英語が必要です。

カメラモードで知りたいものの写真を撮り、アプリに「そこに映っているものが何かを教えて」などと話しかけることで、写真に写っているものの詳細を音声で教えてくれます。

写真を撮るところまではBe My AIも同じですが、あちらはテキストで表示され、こちらは音声のみというシンプルさです。

日本語のテキストを読ませてみた

ためしにこのウェブサイトの画面を写真をとってどう説明するかをみてみました。

日本語で書かれているウェブサイトのページであること、画像にクワガタのようなものが映り込んでいることなどを教えてくれました。

残念ながら書かれている文章の内容までは教えてもらえませんでしたが、記事内の画像はかなり詳しく説明されるところに驚きました。

1枚の写真から読み取れる情報の量や描写という点では、Be My AIを超えているかもしれません。

美術館でこれを使ったらどんなふうに教えてくれるんだろう、とわくわくします。

背景や表情まで詳細に教えてくれる

次は少し難易度を上げて抽象度の高いもの、ということでアニメのキャラクターのフィギュアで試してみました。ドラえもんやドラゴンボールなど、ポピュラーなキャラクターはしっかり認識し、英語で固有名詞を使って説明していました。

比較対象として同じものをBe My AIでも試しました。

簡潔明瞭に説明するBe My AIと比較すると、EMVI(エンヴィ)は写真の中央に映るキャラクターについてはより詳細に、たとえば身に着けている服や目の色といった特徴を細かく説明してくれたうえ、これが屋外であることや背景に映っているものの情報も。

今回いくつかのキャラクターを撮影しましたが、たとえば笑顔のキャラクターは「笑っている」など表情についても教えてくれました。こういう情報までわかるなんて、すごいのひとこと。

音声がメインなのでテキストは画面に表示されませんが、対象について詳細に知りたい場合はとても便利です。

ロボットまで認識した

さいごに、ちょっといじわるをしてみました。使ったのは分身ロボットのOriHime(オリヒメ)。さすがにロボットじゃわからないでしょう…わかりません、とか言うのではないかと思ったけれど、なんと「コミュニケーションロボット」と認識し、見ための特徴もしっかり伝えてくれました。やっぱりすごい…!

リリース前のため、今回紹介した機能は今後変更となる可能性もあります。

とはいえ、リリース前でもこの使いごこちの良さ。正直おどろきました。今からリリースが待ち遠しいです。そして日本語対応もぜひ期待したいアプリでした。

「EMVI(エンヴィ)」ページURLは以下から

本文ここまで